Kontekst zmian: dlaczego OpenAI aktualizuje modele w API

Po co w ogóle zmieniać dobrze działające modele

Aktualizacje modeli OpenAI w API nie wynikają z kaprysu, tylko z tempa rozwoju samej technologii i rosnących wymagań użytkowników. Nowe modele OpenAI w API zwykle wprowadzają trzy grupy zmian: lepszą jakość odpowiedzi, większą spójność zachowania (mniej „humorów” modelu) oraz nowe możliwości, takie jak obsługa obrazów, plików czy zaawansowane wywoływanie narzędzi. Do tego dochodzą optymalizacje wydajności i kosztów – nowsze modele często są tańsze lub szybsze przy tej samej lub wyższej jakości.

Z punktu widzenia biznesu kluczowe jest to, że OpenAI traktuje modele jak usługi w cyklu życia: pojawiają się nowe wersje, starsze są wygaszane, a modele „flagowe” z czasem stają się „ekonomicznymi” i ustępują miejsca kolejnym generacjom. Jeśli aplikacja jest przywiązana do jednej, starej nazwy modelu, prędzej czy później zacznie sprawiać problemy – od gorszej jakości aż po komunikat w stylu „model deprecated” i błędy 4xx.

Cykl życia modeli: od preview do wygaszenia

Nowe modele OpenAI API przechodzą zwykle powtarzalny cykl życia. Na początku pojawia się model oznaczony często jako preview lub z datą, np. „gpt-4.1-preview”. Taki model ma dać dostęp do nowych możliwości, ale z zastrzeżeniem, że interfejs lub zachowanie mogą jeszcze się zmieniać. W kolejnym kroku model otrzymuje stabilną nazwę („gpt-4.1”), a poprzednie warianty są oznaczane jako legacy lub zapowiadane do wygaszenia w konkretnym terminie.

Żeby nie zaskoczyły Cię „niespodzianki” w produkcji, warto założyć w architekturze miejsce na zmiany modelu:

- konfiguracja nazwy modelu poza kodem (np. w zmiennych środowiskowych),

- mechanizm prostego przełączenia na inny model (router modeli),

- procedura testów regresyjnych przed każdą większą zmianą.

Dzięki temu zmiana z GPT‑3.5 na nową generację czy migracja z jednej wersji GPT‑4 na kolejną sprowadza się do kontrolowanej aktualizacji, a nie gaszenia pożaru w piątek po południu.

Konsekwencje dla istniejących integracji

Zmiany w modelach i API wpływają na istniejące integracje na kilka sposobów. Część zachowuje się bezproblemowo – np. gdy OpenAI podmienia model pod tą samą nazwą na lepszą wersję bez zmiany interfejsu. Wtedy aplikacja działa dalej, a Ty po prostu korzystasz z nowszej generacji modelu. Ale bywa też inaczej.

Najczęstsze konsekwencje w praktyce to:

- Zmiana dostępności endpointu – np. wygaszanie /v1/completions na rzecz /v1/chat/completions.

- Zmiana maksymalnej długości kontekstu – wpływa na strategię chunkowania dokumentów i limity dla użytkownika.

- Zmiana domyślnego zachowania – np. mniejsza skłonność do halucynacji, inne domyślne temperatury, bardziej „ostrożne” odpowiedzi.

- Zmiana cennika – nowy model o lepszej jakości może być tańszy za 1k tokenów niż poprzednik, ale przy większym kontekście całkowity koszt jednego requestu może rosnąć.

W dobrze zaprojektowanej integracji jedyną konieczną zmianą bywa podmiana nazwy modelu w konfiguracji i lekkie dostrojenie promptów. W źle zaprojektowanej – cała logika aplikacji opiera się na specyfice starego modelu i migracja wymaga gruntownej przebudowy.

Jak czytać changelog i roadmapę OpenAI z pożytkiem

Oficjalny changelog i roadmapa OpenAI bywają intensywne: wiele nazw modeli, dat, oznaczeń preview, informacje o wygaszaniu, nowościach typu multimodalność czy tool calling. Żeby z tego chaosu wyciągnąć praktyczną wiedzę, warto patrzeć na zmiany przez pryzmat własnej aplikacji, a nie wszystkich możliwych funkcji.

Dobrą taktyką jest prosty filtr:

- Czy ta zmiana dotyczy modelu, którego używam? Jeśli nie – odkładasz temat.

- Czy zmienia się endpoint lub format żądania? Jeśli tak – priorytet wysoki.

- Czy zmieniają się ceny lub limity kontekstu? To wpływa na budżet – priorytet wysoki.

- Czy pojawia się funkcja zastępująca własne „obejścia”? Np. wbudowane tool calling zamiast własnej implementacji – to może uprościć kod.

W praktyce nie ma sensu gonić każdej nowinki w dniu premiery. Bardziej opłaca się mieć kwartalny rytm przeglądu zmian i osobny, szybszy tryb reakcji tylko dla tych aktualizacji, które: zmieniają model używany w misjach krytycznych lub wpływają na koszty w sposób nie do pominięcia.

Przegląd nowych modeli w API i ich przeznaczenia

Mapa: tekst, multimodalność, embeddingi, modele wyspecjalizowane

Nowe modele OpenAI w API można uporządkować według przeznaczenia. Pomaga to szybko dobrać właściwy wariant do konkretnego zadania, zamiast „wpychać” jeden flagowy model do wszystkiego. Najczęściej spotkasz cztery grupy:

- Modele tekstowe / dialogowe – główne LLM w stylu GPT‑4.x, obsługujące chat, generowanie treści, analizę, kod.

- Modele multimodalne – potrafią pracować z tekstem, obrazami, czasem także plikami czy dłuższymi dokumentami.

- Modele embeddingów – generują wektory liczbowe do wyszukiwania semantycznego, RAG, klastrowania.

- Modele wyspecjalizowane – np. modele optymalizowane pod kod, rozpoznawanie obrazów, moderację treści.

W ramach każdej grupy zwykle istnieje model flagowy (najwyższa jakość, szersze możliwości) oraz jeden lub kilka tańszych wariantów, które lepiej nadają się do zadań masowych, gdzie kluczowy jest koszt i prędkość, a nie absolutnie najwyższa jakość.

Flagowy model vs tańsze warianty: kiedy który wybrać

Migracja z GPT‑3.5 i GPT‑4 na nowe generacje niemal zawsze rodzi to samo pytanie: użyć nowego, flagowego modelu wszędzie czy mieszać go z tańszymi wersjami? W praktyce najrozsądniejsze podejście to kombinacja:

- Flagowy model – do zadań, gdzie liczy się dokładność, złożony kontekst, interpretacja regulacji, krytyczne decyzje biznesowe, generowanie ważnych dokumentów.

- Tańszy model – do prostych zadań: podsumowania krótkich treści, klasyfikacje, masowe generowanie wariantów tekstów, podpowiedzi w UI, wstępna analiza danych.

Typowy schemat w produkcyjnych aplikacjach to router modeli: jedna warstwa w kodzie decyduje, który model obsłuży dane żądanie. Dzięki temu możesz mieć:

- flagowy model dla zadań „premium” (np. przygotowanie oferty handlowej),

- tańszy model dla bieżących interakcji (np. odpowiadanie na proste FAQ),

- jeszcze tańszy model dla wewnętrznych zadań back-office (np. tagowanie ticketów).

Ta warstwa abstrakcji pozwala eksperymentować z nowymi modelami OpenAI API bez dotykania każdej funkcji aplikacji osobno.

Jakość, kontekst, szybkość, koszt – co naprawdę się zmienia

Nowe modele OpenAI w API zazwyczaj podnoszą poprzeczkę jakościową: lepiej śledzą instrukcje, rzadziej „halucynują”, są bardziej spójne między odpowiedziami. Równocześnie rosną limity kontekstowe, co ma ogromne znaczenie przy aplikacjach typu RAG i pracy z długimi dokumentami. Zamiast skomplikowanego dzielenia tekstu na małe fragmenty można często przesłać większą porcję treści jednorazowo.

Trzeba jednak uwzględnić kompromis między czasem odpowiedzi a wielkością kontekstu. Duże zapytania z długim promptem i obszerną historią rozmowy siłą rzeczy będą wolniejsze i droższe. W efekcie:

- przy prostych zadaniach szybszy i tańszy model będzie lepszy w ujęciu biznesowym,

- przy złożonych zadaniach flagowy model, nawet jeśli droższy, może obniżyć całkowity koszt (mniej poprawek, mniej dodatkowych zapytań).

Aktualizacje często zmieniają też domyślne parametry bezpieczeństwa (np. moderacja, systemowe guardraile). To wpływa na to, jak model odpowiada w sytuacjach granicznych – o tym szerzej w sekcji o bezpieczeństwie i zgodności.

Przykładowe scenariusze: chatbot, generowanie treści, analizy, kod, RAG

Nowe modele OpenAI API najlepiej widać na konkretnych scenariuszach:

- Chatbot obsługi klienta – flagowy model do trudnych spraw (reklamacje, skomplikowane umowy), tańszy model do prostych pytań o status zamówienia czy godziny otwarcia.

- Generowanie treści marketingowych – flagowy model do tworzenia głównych tekstów (landing page, kluczowe maile), tańszy do przeróbek, skracania, A/B testów nagłówków.

- Analiza danych tekstowych – nowy model z dużym kontekstem do analizy całych raportów lub logów, plus embeddingi do wyszukiwania podobnych fragmentów.

- Asystent programisty – wyspecjalizowany model do kodu, z tool calling do bezpiecznego wykonywania wybranych akcji (np. generowanie pull requestów, nie wykonywanie komend shellowych).

- RAG (Retrieval-Augmented Generation) – połączenie embedów z dużym kontekstem: model otrzymuje streszczone wyniki wyszukiwania i buduje odpowiedź bez „wymyślania” z głowy.

W każdym z tych scenariuszy przejście z GPT‑3.5 na nowsze modele zwykle podnosi jakość odpowiedzi na tyle, że można ograniczyć liczbę dodatkowych zapytań, powtórek i ręcznych poprawek. To często kompensuje wyższą cenę za 1k tokenów.

Kluczowe zmiany w API: endpointy, parametry, format zapytań

Przejście z /completions na /chat/completions i nowsze schematy

Jedną z najważniejszych zmian, z którą zderza się większość integracji, jest odejście od starego endpointu /completions na rzecz /chat/completions. Ten drugi jest „natywnym” interfejsem dla modeli konwersacyjnych, pozwala lepiej sterować kontekstem i rolami, a do tego integruje nowe funkcje (tool calling, multimodalność).

W starym podejściu wysyłałeś jeden tekstowy prompt i dostawałeś jedną odpowiedź. W nowym – przekazujesz listę wiadomości z rolami: system, user, assistant, opcjonalnie też tool. Dzięki temu model rozumie, które fragmenty są instrukcją, które historią rozmowy, a które informacją zwrotną z narzędzi. To daje dużo większą kontrolę nad zachowaniem modelu.

Struktura wiadomości: role i treści różnych typów

Dla nowych modeli OpenAI w API kluczowa jest poprawna struktura wiadomości. Przykładowy request do /chat/completions może wyglądać tak (uproszczony przykład tekstowy):

POST /v1/chat/completions

{

"model": "gpt-4.1",

"messages": [

{

"role": "system",

"content": "Jesteś asystentem wspierającym dział obsługi klienta sklepu z elektroniką."

},

{

"role": "user",

"content": "Klient pyta, czy może zwrócić laptopa po 40 dniach od zakupu."

}

]

}

Nowe modele mogą też przyjmować content jako tablicę elementów różnych typów, np. tekst i obraz. Przykładowa struktura (schematycznie):

"messages": [

{

"role": "user",

"content": [

{ "type": "text", "text": "Co jest na tym obrazku?" },

{ "type": "image_url", "image_url": { "url": "https://..." } }

]

}

]

Ten format otwiera drogę do multimodalnych zastosowań: analiza zdjęć, zrzutów ekranu, faktur, diagramów. Jeśli Twoja aplikacja ma korzystać z nowych multimodalnych modeli OpenAI API, architektura requestów musi być dostosowana do takiego schematu.

Nowe parametry i te, które odchodzą

Wraz z nowymi modelami OpenAI API pojawiają się dodatkowe parametry (np. związane z tool calling), a część starych traci znaczenie lub jest oznaczana jako przestarzała. Przykłady zmian, z którymi użytkownicy często się zderzają:

- temperature – nadal kluczowy parametr sterujący kreatywnością; nowe modele bywają bardziej stabilne przy tych samych wartościach.

- top_p – alternatywny sposób kontroli losowości, ale nie zawsze jest potrzebny; niektórzy producenci SDK wręcz sugerują korzystanie z jednego z tych parametrów, nie obu jednocześnie.

- max_tokens – limit generowanej odpowiedzi; przy większych kontekstach trzeba go dostosować, żeby uniknąć obciętych odpowiedzi.

Parametry związane z tool calling i multimodalnością

Nowe modele OpenAI API mocno integrują się z narzędziami (tool calling) oraz multimodalnością. W requestach pojawiają się więc dodatkowe pola, które trzeba poprawnie obsłużyć w kodzie:

- tools – definicje funkcji/narzędzi, które model może wywołać (schemat JSON, nazwa, opis, parametry).

- tool_choice – sposób wyboru narzędzia: automatyczny (

"auto"), wymuszone konkretne narzędzie lub brak narzędzi. - response_format – format odpowiedzi (np. wymuszony JSON), przydatny przy integracjach z backendem bez dodatkowego parsowania.

- modalities / input_image / vision_config – w nowszych SDK mogą pojawiać się dodatkowe pola związane z obrazami lub innymi typami wejścia.

Minimalny przykład użycia tool calling (schematycznie):

{

"model": "gpt-4.1",

"messages": [

{ "role": "user", "content": "Jaka jest pogoda w Warszawie?" }

],

"tools": [

{

"type": "function",

"function": {

"name": "getWeather",

"description": "Zwraca pogodę dla miasta",

"parameters": {

"type": "object",

"properties": {

"city": { "type": "string" }

},

"required": ["city"]

}

}

}

],

"tool_choice": "auto"

}

Backend musi potem przechwycić odpowiedź z rolą assistant i typem tool_call, wywołać faktyczną funkcję w kodzie i przekazać wynik z powrotem jako wiadomość tool. To zmienia przepływ integracji: zamiast jednego requestu i jednej odpowiedzi, pojawia się sekwencja wymian z modelem.

Zmiany w strumieniowaniu (stream) i obsłudze odpowiedzi

Nowsze modele i SDK wprowadzają drobne, ale istotne zmiany w streamingu. Po stronie backendu trzeba zaktualizować:

- logikę scalania fragmentów odpowiedzi (chunks) – szczególnie, gdy model może w trakcie streamu przejść w tryb tool calling,

- obsługę

deltaw strumieniu – nowe pola, np. częściowetool_calls, - timeouty i obsługę błędów – strumieniowanie długich odpowiedzi po większych kontekstach jest bardziej wrażliwe na przerwane połączenia.

Jeśli aplikacja korzysta z WebSocketów lub SSE do przesyłania strumienia dalej (np. do frontendu), przy aktualizacji modeli dobrze jest przejrzeć:

- format zdarzeń wysyłanych do UI,

- zasady „zamykania” strumienia (ostatni chunk, flaga końca odpowiedzi),

- obsługę przypadków, gdy model zamiast tekstu decyduje się na wywołanie narzędzia.

Migracja z wcześniejszych modeli (GPT‑3.5, GPT‑4) na nowe wersje

Strategia migracji: big bang czy stopniowe przełączanie

Migrację można zrobić na dwa sposoby:

- Big bang – jednorazowe przełączenie wszystkich requestów na nowy model.

- Stopniowo – procentowe lub funkcjonalne przełączanie (np. najpierw nowe feature’y, potem główne ścieżki).

W praktyce przy aplikacjach produkcyjnych bezpieczniejsze jest podejście stopniowe. Prosty plan:

- Wprowadzić w kodzie warstwę abstrakcji na wywołania modeli (np.

llmClient.call(modelId, payload)). - Dodać możliwość przełączania modelu z konfiguracji/feature flag.

- Uruchomić nowy model na małym procencie ruchu lub na wybranych endpointach.

- Zmierzyć jakość, koszt, czas odpowiedzi.

- Dopiero po stabilizacji zwiększać udział nowego modelu.

Zmiana endpointów i schematów requestów w istniejącym kodzie

Przy migracji z GPT‑3.5 / GPT‑4 na nowe wersje często trzeba wykonać serię technicznych kroków:

- Jeśli gdziekolwiek wciąż jest używany

/v1/completions, przepisać integrację na/v1/chat/completions. - Ujednolicić sposób budowy listy

messagesw całej aplikacji. - Wyodrębnić funkcję odpowiedzialną za konwersję „starego promptu” do nowego formatu (np. z surowego tekstu na role: system/user).

- Upewnić się, że biblioteki klienckie (SDK) mają aktualną wersję – stare SDK potrafią nie obsługiwać nowych pól odpowiedzi.

Przykładowa transformacja starego podejścia:

// Stare (schematycznie):

prompt = "Ty: " + userInput + "nAI:"

// Nowe:

messages = [

{ role: "system", content: "Jesteś pomocnym asystentem." },

{ role: "user", content: userInput }

]

Taka refaktoryzacja znacząco ułatwia podmianę modeli i testy A/B.

Testy porównawcze: jak ocenić, czy nowy model „jest lepszy”

Zamiast opierać się na subiektywnych wrażeniach, użyj prostych testów porównawczych. Minimalny zestaw:

- Przygotować zestaw realnych promptów z produkcji (np. losowa próbka z logów zanonimizowanych z wrażliwych danych).

- Dla każdego promptu uruchomić oba modele (stary i nowy) z tymi samymi parametrami.

- Ocenić odpowiedzi: ręcznie (np. zespół supportu) lub półautomatycznie (ocena LLM, scoring regułami).

Przykładowy workflow:

- Zrzut 500 realnych zapytań.

- Batch call do starego modelu i zapis odpowiedzi.

- Batch call do nowego modelu dla tych samych zapytań.

- Porównanie według prostych kryteriów: poprawność merytoryczna, zwięzłość, zgodność z regulaminem, liczba „nie wiem”.

Dla klientów B2B często wystarczy, że nowy model redukuje liczbę eskalacji do człowieka o kilka–kilkanaście procent, żeby migracja była opłacalna biznesowo.

Modyfikacja promptów przy migracji

Nowe modele OpenAI zwykle lepiej rozumieją instrukcje, ale też mają inne „domyślne” zachowania. W praktyce:

- prompty, które kiedyś były bardzo szczegółowe, można uprościć,

- część „obejść” starych błędów (workaroundów) można usunąć,

- instrukcje bezpieczeństwa warto przenieść do roli

system, nie mieszać ich z treścią użytkownika.

Zanim zmienisz prompty masowo, dobrze jest:

- Skopiować istniejące prompty 1:1 do nowego modelu.

- Sprawdzić, czy zachowanie jest akceptowalne.

- Dopiero potem iteracyjnie upraszczać i optymalizować (często obniża to koszt i wydłuża maksymalny kontekst).

Koszty, limity i wydajność po aktualizacjach modeli

Nowy model a rachunki: jak policzyć realny koszt

Sama cena za 1k tokenów nie mówi wiele bez kontekstu. Na koszt wpływają:

- liczba tokenów wejściowych (prompt + historia rozmowy + wyniki RAG),

- liczba tokenów w odpowiedzi,

- liczba requestów na użytkownika / sesję,

- liczba „nieudanych” odpowiedzi wymagających powtórzenia.

Prosty sposób na test:

- Włączyć logowanie liczby tokenów (większość SDK zwraca

usagew odpowiedzi). - Policzyć średni koszt sesji użytkownika na starym i nowym modelu.

- Porównać to z liczbą zgłoszeń do supportu / eskalacji / zwrotów.

Często okazuje się, że droższy model obniża ogólny koszt obsługi przez lepszą jakość i mniejszą liczbę interakcji.

Limity kontekstu i ich konsekwencje

Nowsze modele oferują konteksty liczone w dziesiątkach, a czasem setkach tysięcy tokenów. To otwiera nowe scenariusze, ale wprowadza też ryzyka:

- łatwo przesadzić z ilością danych w promptach RAG i „przepalać” budżet,

- duże konteksty wydłużają czas odpowiedzi, szczególnie przy streamingu,

- niewłaściwa segmentacja dokumentów może sprawić, że model się „gubi” w nadmiarze informacji.

Praktyczna mikro-checklista dla RAG po aktualizacji modelu:

- zwiększ liczbę dokumentów wstrzykiwanych do kontekstu stopniowo (np. z 3 do 5, z 5 do 8),

- mierz wpływ na jakość odpowiedzi,

- przy długich dokumentach stosuj warstwę streszczania (chunk → summary → kontekst),

- nie dokładaj do kontekstu wszystkiego „na wszelki wypadek”.

Wydajność: latency, równoległość, throttling

Nowe modele bywają szybsze, ale mają też swoje limity szybkości i równoległości. Trzy obszary do ogarnięcia:

- Latency – mierz osobno czas do pierwszego tokena (TTFT) i czas pełnej odpowiedzi.

- Równoległość – jeśli aplikacja robi dużo requestów jednocześnie, ustaw kolejki lub batchowanie.

- Backoff – obsługa kodów błędów 429/5xx z automatycznym retry (np. exponential backoff).

Przykładowa prosta strategia retry:

- pierwszy błąd 429 → retry po 1 s,

- drugi → retry po 2 s,

- trzeci → retry po 4 s, potem poddanie requestu i logowanie.

Nowe możliwości: multimodalność, narzędzia, funkcje wyspecjalizowane

Multimodalny input: tekst + obraz + pliki

Nowe modele potrafią analizować obrazy, zrzuty ekranu, wykresy czy skany dokumentów. Przykładowe zastosowania:

- wsparcie techniczne na podstawie zdjęć urządzenia lub błędu na ekranie,

- ekstrakcja danych z faktur lub dokumentów (połączenie z RAG i narzędziami),

- analiza projektów graficznych (spójność brandu, poprawność layoutu).

Z technicznego punktu widzenia trzeba:

- zaplanować przechowywanie i dostęp do obrazów (URL publiczny, podpisany, proxy backendowe),

- dostarczyć użytkownikowi prosty mechanizm uploadu (front),

- obsłużyć limity rozmiaru i liczby obrazów na jedno zapytanie.

Tool calling jako „mózg” nad Twoimi systemami

Tool calling zamienia model w orkiestratora funkcji backendu. Typowe scenariusze:

- CRM/ERP – model decyduje, kiedy pobrać dane klienta, zaktualizować status, wystawić dokument,

- DevOps – model generuje plan zmian, ale wywołanie faktycznych komend jest zamknięte w ściśle kontrolowanych narzędziach,

- BI – model decyduje, które zapytanie SQL lub raport uruchomić, a potem tłumaczy wynik na naturalny język.

Przy projektowaniu narzędzi:

- lepiej zdefiniować kilka małych, prostych funkcji niż jedno „magiczne” narzędzie z dziesiątkami parametrów,

- opisy funkcji pisać zrozumiale dla człowieka – model lepiej zinterpretuje, kiedy ich użyć,

- w parametrze

parametersjasno opisać typy i ograniczenia (np. enum wartości).

Modele wyspecjalizowane: kod, moderacja, embeddingi

OpenAI rozwija też modele skupione na konkretnych zadaniach:

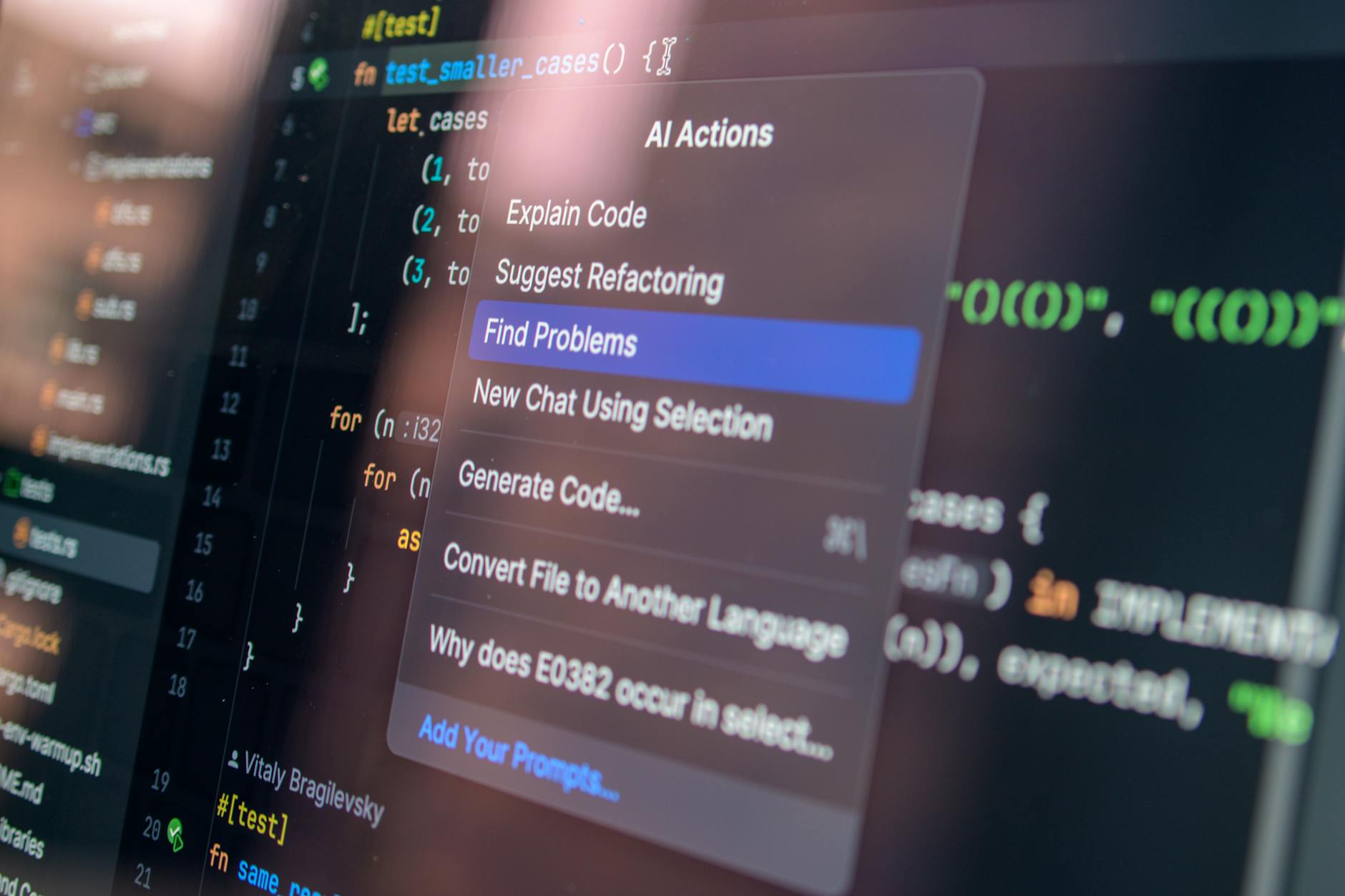

- Modele kodu – lepsze w uzupełnianiu i refaktoryzacji kodu, generowaniu testów, tłumaczeniu między językami programowania.

- Modele moderacji – dedykowane klasyfikacji treści pod kątem regulaminu, bezpieczeństwa i zgodności.

- Modele embeddingów – zoptymalizowane pod wyszukiwanie semantyczne, rekomendacje, klastrowanie treści.

Prosty schemat użycia embeddingów w RAG po aktualizacji:

- Zmienić model embeddingów na nową wersję (lepsze wektory, tańsza cena lub większy wymiar).

- Przebudować wektory w bazie (np. wektorowe indeksy w Pinecone, pgvector, Qdrant).

- Przetestować jakość wyszukiwania – czy trafiają się bardziej adekwatne dokumenty.

W praktyce przejście na nowszy model embeddingów często daje większy skok jakości w RAG niż sama zmiana modelu generatywnego.

Aktualizacja promptów i architektury aplikacji pod nowe modele

Projektowanie „system promptu” dla nowych modeli

System prompt staje się centralnym miejscem, w którym definiujesz rolę i granice modelu. Przy aktualizacji modeli:

- oddziel wyraźnie zasady (policy) od przykładowych zachowań,

Struktura system promptu: modułowo zamiast „ściany tekstu”

Zamiast jednego ogromnego akapitu z zasadami, lepiej podzielić system prompt na logiczne bloki. Na przykład:

- blok roli i tonu (kim jest asystent, jak powinien brzmieć),

- blok ograniczeń (czego nie robi, czego nie może sugerować),

- blok formatu odpowiedzi (nagłówki, listy, język, długość),

- blok domenowy (zasady specyficzne dla produktu, branży, klienta).

Taki podział pozwala łatwiej:

- podmieniać tylko wybrane sekcje przy testach A/B,

- wprowadzać warianty promptu dla różnych klientów/tenantów,

- debugować: szybko widać, czy problem leży w tonie, czy w zasadach bezpieczeństwa.

Przykładowa struktura system promptu w kodzie (schematycznie):

const systemPrompt = `

[ROLA]

Jesteś asystentem obsługi klienta SaaS, piszesz krótko i konkretnie.

[OGRANICZENIA]

- Nie udzielasz porad prawnych ani medycznych.

- Jeśli nie znasz odpowiedzi, jasno to komunikujesz.

[FORMAT]

- Używaj nagłówków H2/H3 tylko gdy odpowiedź jest długa.

- Jeśli wyjaśniasz kroki, używaj list numerowanych.

[DOMENA]

Produkt: platforma do zarządzania subskrypcjami B2B.

`;

Prompt jako konfiguracja produktu, a nie „hardcode” w kodzie

Przy nowych modelach prompt staje się pełnoprawną częścią konfiguracji systemu, nie tylko stringiem w kodzie. Dobrze się sprawdzają:

- pliki konfiguracyjne (YAML/JSON) z polami

systemPrompt/developerPrompt, - panel admina, w którym product owner może modyfikować prompt bez deployu,

- wersjonowanie promptów (np. numer wersji + opis zmian).

Prosty schemat:

- Przenieść prompty do bazy/konfiguracji.

- Dodać pole

prompt_versioni logować je przy każdym requestcie. - Przy regresji jakości szybko sprawdzić, która wersja promptu ją spowodowała.

Warstwa orkiestracji nad modelem

Nowe modele lepiej radzą sobie z „szynami” kontrolującymi przepływ danych. Coraz częściej:

- warstwa orkiestracji (np. własna mini-biblioteka) decyduje, kiedy użyć RAG, kiedy tooli, a kiedy „czystego” czatu,

- ten sam system prompt jest wykorzystywany w kilku ścieżkach (np. chat, e-mail, API publiczne),

- rozszerza się logikę o metadata: język użytkownika, plan taryfowy, poziom uprawnień.

Minimalny zestaw metadanych przy nowym modelu:

user_tier– pozwala różnicować długość/ilość odpowiedzi,channel– chat, e-mail, API; różne wymagania co do formatu,locale– język, wariant (np. polski vs polski techniczny).

Refaktoryzacja architektury: jeden model, wiele ról

Nowe modele często zastępują kilka starych usług. Zamiast:

- osobnego modelu do streszczania,

- osobnego do tłumaczeń,

- osobnego do generowania draftów odpowiedzi,

da się użyć jednego modelu z różnymi system promptami i parametrami. Praktyczny schemat:

- Zdefiniować task profiles – np.

summary,translation,reply_draft. - Każdy profil ma:

- inny system prompt,

- inne parametry (np.

temperature, maks. długość), - inne limity (rate limiting per typ zadania).

- Router w backendzie wybiera profil na podstawie zadania, ale używa tego samego modelu.

Bezpieczeństwo, zgodność i kontrola danych po zmianach modeli

Model jako procesor danych: co zmienia aktualizacja

Przy zmianie modelu de facto zmieniasz procesor danych osobowych po stronie dostawcy. To dotyka:

- RODO/GPDR (rejestr czynności przetwarzania),

- umów powierzenia przetwarzania danych (DPA),

- polityk retention i logowania.

Przy większych organizacjach dobrze jest przygotować prostą checklistę „governance przy zmianie modelu”:

- czy nowy model jest hostowany w tej samej jurysdykcji (np. UE vs US),

- czy zmieniły się zasady trenowania na danych klientów,

- czy trzeba zaktualizować DPIA / ocenę skutków dla ochrony danych.

Konfiguracja privacy: opcje po stronie OpenAI

OpenAI pozwala konfigurować sposób wykorzystania danych. Przy migracji:

- sprawdzić, czy ustawienia „no training” / „data retention” nie resetują się przy nowych endpointach,

- zweryfikować, jakie logi są przechowywane po stronie dostawcy (treść vs metadane),

- ograniczyć wysyłanie danych wrażliwych do minimum (np. pseudonimizacja po stronie backendu).

Przykładowe minimum techniczne:

- Tokenizacja lub maskowanie danych osobowych przed wysłaniem do API (np.

<USER_123>zamiast imienia i nazwiska). - Odmaskowanie już po stronie klienta, na podstawie lokalnych mapowań.

- Losowe ID konwersacji zamiast realnych identyfikatorów użytkownika.

Separacja tenantów i danych w aplikacjach B2B

Przy zmianie modeli pojawia się pokusa, by „spiąć wszystko razem”, szczególnie z RAG. W środowisku B2B trzeba pilnować:

- oddzielnych indeksów wektorowych na tenantów (lub mocnego

tenant_idjako filtra), - oddzielnych bucketów na pliki źródłowe,

- logów zawierających identyfikator tenanta, żeby można było wykonać „prawo do bycia zapomnianym”.

Przykład prostego modelu uprawnień:

- każdy dokument w indeksie embeddingów ma pola:

tenant_id,visibility,owner_id, - warstwa wyszukiwania zawsze filtruje po

tenant_id, - model dostaje już przefiltrowane wyniki, nie ma dostępu do surowej bazy.

Bezpieczeństwo promptów i tooli

Silniejsze modele potrafią bardziej „kreatywnie” wykorzystywać narzędzia, co zwiększa ryzyko:

- eskalacji uprawnień przez prompt injection,

- wywołania komend spoza kontekstu użytkownika,

- ujawnienia poufnych informacji z poprzednich kroków.

Podstawowe zasady:

- każde narzędzie powinno działać w granicach uprawnień aktualnego użytkownika (autoryzacja po stronie backendu, nie modelu),

- nie przekazuj modelowi tokenów dostępowych ani haseł,

- traktuj output modelu jak propozycję, którą backend musi zweryfikować.

Dobry wzorzec: model może poprosić o „wykonanie akcji X na zasobie Y”, ale to backend sprawdza, czy użytkownik ma do tego prawo i dopiero wtedy wywołuje wewnętrzne API.

Typowe błędy i pułapki przy przechodzeniu na nowe modele OpenAI

Zbyt szybkie „wyłączanie” starego modelu

Częsty scenariusz: nowy model w testach wygląda świetnie, więc stary jest wyłączany od razu. A potem okazuje się, że:

- dla niszowych przypadków (edge cases) stary model radził sobie lepiej,

- część klientów przyzwyczaiła się do konkretnego stylu odpowiedzi,

- nie ma łatwego rollbacku.

Bezpieczniejsza sekwencja:

- Testy offline na logach (jak opisane wcześniej).

- Canary release na małym procencie ruchu (np. 5–10%).

- Stopniowe zwiększanie udziału nowego modelu + porównanie metryk.

- Dopiero na końcu wyłączenie starego, ale z możliwością szybkiego powrotu (feature flag).

Brak kontroli nad dryfem jakości

Nowy model na starcie działa świetnie, lecz po kilku tygodniach:

- prompty zostały „dopchane” dodatkowymi wymaganiami,

- pojawiły się nowe narzędzia i warstwy,

- kontekst urósł do poziomu, który rozmywa priorytety.

Rozwiązaniem jest proste monitorowanie jakości, nie tylko ilości requestów:

- tagowanie konwersacji oznaczonych jako „nieużyteczne” przez użytkowników,

- regularne audyty losowej próbki odpowiedzi,

- prosta ocena „przed/po” przy każdej większej zmianie promptu lub architektury.

Ignorowanie specyfiki nowych parametrów modeli

Nowe modele mogą inaczej reagować na:

temperature(często sensowne jest jej obniżenie),top_pi inne parametry samplingowe,- limity odpowiedzi (liczba tokenów outputu).

Typowa pułapka: skopiowanie konfiguracji 1:1 ze starego modelu. W praktyce:

- w modelach lepszych w rozumowaniu często można mieć niższą

temperaturei krótsze odpowiedzi, - sztuczne ograniczenie maksymalnej długości odpowiedzi bywa zbędne – model sam „trzyma się tematu”,

- przy generacji kodu lub długich treści warto zwiększyć limit, żeby uniknąć uciętych odpowiedzi.

Niedoszacowanie wpływu na UX

Zmiana modelu to nie tylko zmiana „silnika pod maską”. Często:

- odpowiedzi są krótsze/dłuższe,

- model inaczej formatuje treści (więcej list, nagłówków),

- zmienia się sposób przyznawania do braku wiedzy („nie wiem” vs halucynacja).

Przy migracji dobrze przejść przez:

- krótkie testy UX z realnymi użytkownikami (nawet kilka osób z supportu / sprzedaży),

- analizę najważniejszych scenariuszy (onboarding, błędy, trudne pytania),

- dostosowanie interfejsu (np. pokazanie, że odpowiedź jest „szkicem” do akceptacji).

Mieszanie instrukcji z danymi użytkownika

Przy nowych modelach ryzyko prompt injection jest wyższe, jeśli instrukcje bezpieczeństwa są w roli user albo wstrzykiwane do kontekstu razem z dokumentami. Typowy błąd:

messages = [

{ role: "user", content: "Jesteś asystentem banku. Nie podawaj haseł..." },

{ role: "user", content: actualUserQuestion }

]

Prawidłowo:

messages = [

{ role: "system", content: "Jesteś asystentem banku. Nie podawaj haseł..." },

{ role: "user", content: actualUserQuestion }

]

Dodatkowo dane z RAG warto izolować w osobnych blokach (np. poprzedzonych jasnym tagiem), żeby atakujący nie mógł nadpisać instrukcji systemowych zwykłym tekstem w dokumencie.

Nieregularne czyszczenie i skracanie kontekstu

Przy długich sesjach z nowymi modelami łatwo dojść do tysięcy tokenów historii konwersacji. Skutki:

- wzrost kosztów pojedynczej interakcji,

- spadek trafności (model zaczyna „gubić się” w starej historii),

- większe ryzyko ujawnienia dawnych informacji w nowej odpowiedzi.

Prosta strategia:

- Trzymać w historii tylko ostatnie kilka wymian (np. 5–10),

- starszą historię streszczać co jakiś czas i zastępować streszczeniem,

- wycinać elementy niezwiązane z danym wątkiem (np. small talk).

Brak planu na awarie i zmiany po stronie OpenAI

Aktualizacja modeli to też ryzyko:

- czasowych niedostępności nowego endpointu,

- zmian w limitach, które pojawiają się z krótkim wyprzedzeniem,

- deprecjacji starszych wersji szybciej, niż zakładano.

W praktyce przydaje się:

- warstwa abstrakcji na poziomie backendu (np.

llmClient.generate()zamiast bezpośrednich wywołań SDK w całym kodzie), - konfiguracja modeli z zewnątrz (ENV/konfiguracja),

- fallback na inny model lub tryb degraded (np. brak RAG, krótsze odpowiedzi) przy błędach 5xx / 429.

Najczęściej zadawane pytania (FAQ)

Dlaczego OpenAI ciągle zmienia modele w API i wygasza stare wersje?

Modele traktowane są jak usługi w cyklu życia: pojawia się wersja preview, potem stabilna, a starsze warianty są oznaczane jako legacy i z czasem wygaszane. Powód jest prosty – technologia idzie do przodu: rośnie jakość odpowiedzi, pojawiają się nowe funkcje (multimodalność, tool calling), a do tego dochodzą niższe koszty i lepsza wydajność.

Jeśli aplikacja trzyma się kurczowo jednej, starej nazwy modelu, w pewnym momencie pojawią się problemy: spadek jakości, gorsza dostępność, a w końcu komunikaty o deprecacji i błędy 4xx. Lepiej z góry założyć, że model to „wymienialny komponent”, a nie coś na stałe wpisane w kod.

Jak przygotować aplikację na zmiany modeli OpenAI, żeby nie psuło produkcji?

Podstawą jest architektura, która zakłada wymianę modeli bez przebudowy całej aplikacji. Minimalny zestaw to:

- nazwa modelu trzymana w konfiguracji (np. zmienne środowiskowe), a nie „zaszyta” w kodzie,

- prosty router modeli – jedna warstwa, która decyduje, jakiego modelu użyć do danego zadania,

- procedura testów regresyjnych przed przełączeniem na nowy model (porównanie odpowiedzi na typowych przypadkach).

Dzięki temu migracja z GPT‑3.5 na nowszą generację czy zmiana wersji GPT‑4 sprowadza się do kontrolowanej aktualizacji konfiguracji, a nie awaryjnego łatania produkcji w ostatniej chwili.

Jak zmiany modeli OpenAI wpływają na istniejące integracje w praktyce?

Najczęściej zmiany obejmują kilka obszarów naraz. Typowe skutki dla istniejącej integracji to:

- zmiana lub wygaszanie endpointów (np. przejście z

/v1/completionsna/v1/chat/completions), - nowe limity kontekstu – trzeba zaktualizować strategię dzielenia dokumentów i limity po stronie UI,

- zmienione domyślne zachowanie modelu (mniej halucynacji, inne „wyważenie” odpowiedzi),

- nowy cennik – często tańszy koszt za 1k tokenów, ale przy większym kontekście rośnie koszt pojedynczego requestu.

W dobrze zaprojektowanej integracji zwykle wystarczy podmienić nazwę modelu w konfiguracji i lekko skorygować prompty. Jeśli cała logika aplikacji została „napisana pod konkretne humory” starego modelu, migracja bywa znacznie bardziej bolesna.

Jak czytać changelog i roadmapę OpenAI, żeby wyłapać tylko ważne zmiany?

Zamiast śledzić każdą nowinkę, filtruj informacje przez pryzmat własnej aplikacji. Praktyczny filtr to cztery pytania:

- czy zmiana dotyczy modelu, którego faktycznie używasz,

- czy zmienia się endpoint lub format żądania (to ma wysoki priorytet),

- czy zmieniają się ceny lub limity kontekstu (wpływ na budżet),

- czy pojawia się funkcja, która może zastąpić Twoje „obejścia” w kodzie (np. natywny tool calling).

Sprawdza się prosty rytm: przegląd zmian raz na kwartał + szybsza reakcja tylko wtedy, gdy aktualizacja dotyka modelu używanego w procesach krytycznych lub mocno wpływa na koszty.

Jaki model OpenAI wybrać: flagowy czy tańszy wariant?

Flagowy model sprawdza się tam, gdzie liczy się dokładność i złożony kontekst: interpretacja regulacji, decyzje biznesowe, generowanie ważnych dokumentów, trudne przypadki supportowe. Tańsze modele wystarczą do masowych, prostych zadań – prostych podsumowań, klasyfikacji, tagowania ticketów, podpowiedzi w interfejsie.

Dobrym wzorcem jest router modeli: jedna warstwa w aplikacji decyduje, czy użyć modelu „premium”, czy „ekonomicznego”. Przykład: flagowy model przygotowuje ofertę handlową, tańszy obsługuje bieżące FAQ, a jeszcze tańszy klasyfikuje zgłoszenia w back-office.

Co się zmienia przy nowych modelach: jakość, kontekst, szybkość czy koszt?

Przy nowych generacjach zwykle rośnie jakość odpowiedzi (lepsze trzymanie się instrukcji, mniej halucynacji) oraz dostępny kontekst – można wrzucić dłuższe dokumenty lub dłuższą historię rozmowy. Często spada też koszt w przeliczeniu na 1k tokenów lub skraca się czas odpowiedzi przy tej samej jakości.

Jednocześnie dłuższy kontekst oznacza większy koszt i wolniejszą odpowiedź przy bardzo dużych zapytaniach. Biznesowo opłaca się łączyć modele: do prostych zadań – szybszy i tańszy wariant, do złożonych – flagowy model, który mimo wyższej stawki może finalnie obniżyć koszt (mniej poprawek i dodatkowych wywołań).

Jak często aktualizować model w produkcyjnej aplikacji opartej na OpenAI API?

Nie ma sensu przeskakiwać na każdą wersję w dniu premiery. Praktyczny schemat to:

- lekki przegląd changeloga co kwartał i zaplanowane testy nowych „głównych” wersji,

- natychmiastowa analiza tylko wtedy, gdy OpenAI ogłasza deprecację używanego modelu albo znaczące zmiany cen/limitów.

Dodatkowo dobrze mieć środowisko testowe z tym samym ruchem co produkcja (np. odtworzone sesje z logów). Dzięki temu można spokojnie porównać stary i nowy model, zanim zmieni się konfigurację na produkcji.

Źródła informacji

- OpenAI API Documentation. OpenAI – Oficjalny opis modeli, endpointów, limitów kontekstu i cyklu życia API

- OpenAI Changelog. OpenAI – Historia zmian modeli, wygaszania, nowych funkcji i aktualizacji cen

- Attention Is All You Need. NeurIPS (2017) – Podstawy architektury transformerów wykorzystywanych w modelach językowych

- Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks. Association for Computational Linguistics (2020) – Opis RAG, użycie embeddingów i kontekstu w aplikacjach produkcyjnych

- MLOps: Continuous Delivery and Automation Pipelines in Machine Learning. O’Reilly Media (2020) – Praktyki cyklu życia modeli, wersjonowanie i zarządzanie zmianami w produkcji